Sztuczna inteligencja rewolucjonizuje przemysł muzyczny, oferując zautomatyzowane narzędzia do komponowania, masteringu i występów. Algorytmy sztucznej inteligencji generują nowe kompozycje, przewidują hity i personalizują wrażenia słuchacza, zmieniając produkcję, dystrybucję i konsumpcję muzyki. Ta rozwijająca się technologia stwarza zarówno ekscytujące możliwości, jak i trudne dylematy etyczne.

Modele uczenia maszynowego (ML) wymagają danych treningowych do skutecznego działania, podobnie jak kompozytor potrzebuje nut do napisania symfonii. W świecie muzyki, gdzie melodia, rytm i emocje przeplatają się ze sobą, nie można przecenić znaczenia wysokiej jakości danych treningowych. Jest to podstawa opracowywania solidnych i dokładnych modeli ML muzyki do analizy predykcyjnej, klasyfikacji gatunków lub automatycznej transkrypcji.

Dane, siła napędowa modeli ML

Uczenie maszynowe jest z natury oparte na danych. Te modele obliczeniowe uczą się wzorców na podstawie danych, umożliwiając im przewidywanie lub podejmowanie decyzji. W przypadku muzycznych modeli uczenia maszynowego dane treningowe często zawierają zdigitalizowane ścieżki muzyczne, teksty piosenek, metadane lub kombinację tych elementów. Jakość, ilość i różnorodność tych danych znacząco wpływa na efektywność modelu.

Jakość: harmonia danych

Jakość jest kluczowym aspektem każdego zestawu danych szkoleniowych. Wysokiej jakości dane dla muzycznych modeli ML oznaczają, że są dokładnie oznaczone bez szumów i błędów. Na przykład, jeśli model ma na celu sklasyfikowanie gatunków muzycznych, dane treningowe powinny być poprawnie otagowane odpowiednimi gatunkami. Każde błędne oznakowanie może wprowadzić w błąd model, co skutkuje niską wydajnością. Ponadto pliki audio powinny być wolne od obcych szumów, aby model nauczył się właściwych funkcji.

Ilość: Skala uczenia się

Rozmiar zestawu danych szkoleniowych odgrywa znaczącą rolę w zdolności uczenia się modelu. Zasadniczo im więcej danych, tym lepiej. Modele ML wymagają znacznych ilości danych, aby dobrze uogólniać. Duży i zróżnicowany zestaw danych naraża model na liczne scenariusze, zmniejszając prawdopodobieństwo przeuczenia, gdy model zbyt dobrze uczy się danych treningowych i nie działa skutecznie na niewidocznych danych.

Różnorodność: rytm wariancji

Tak jak utwór muzyczny rozwija się dzięki wariacjom, tak różnorodność zestawu danych treningowych ma ogromne znaczenie. Zróżnicowany zestaw danych obejmuje muzykę z różnych gatunków, języków i środowisk kulturowych. Ta różnorodność pomaga zapewnić, że model ML będzie wszechstronny i solidny, zdolny do obsługi szerokiej gamy rodzajów muzyki, nie tylko tych, na których był głównie szkolony.

Droga do modelu Maestro

Aby osiągnąć jakość, ilość i różnorodność danych treningowych, wymaga to skrupulatnego gromadzenia danych, etykietowania i procesów rozszerzania. Inwestycja jest znaczna, ale zwrot jest równie satysfakcjonujący. Dobrze wyszkolony model ML muzyki może zmienić różne aspekty branży muzycznej, od usprawnienia odkrywania muzyki po automatyzację komponowania i masteringu.

Ostatecznie jakość danych treningowych określa, jak skutecznie działa muzyczny model uczenia maszynowego. Dlatego, podobnie jak znaczenie każdej nuty w symfonii, każdy bit danych treningowych składa się na arcydzieło, które jest dobrze wyszkolonym, niezawodnym i dokładnym modelem uczenia maszynowego w branży muzycznej.

Przypadki użycia sztucznej inteligencji w muzyce

Kompozycja muzyczna

Algorytmy sztucznej inteligencji, takie jak OpenAI MuseNet, mogą tworzyć oryginalną muzykę, analizując wzorce i style z istniejącej muzyki. Pomaga to muzykom generować nowe pomysły lub tworzyć ścieżki w tle do różnych celów.

Automatyczne tagowanie

Jest to proces automatycznego przypisywania odpowiednich metadanych lub tagów do utworu muzycznego, co może pomóc w poprawie możliwości wyszukiwania, organizacji i rekomendacji.

Rekomendacja muzyczna

Algorytmy sztucznej inteligencji, takie jak OpenAI MuseNet, mogą tworzyć oryginalną muzykę, analizując wzorce i style z istniejącej muzyki. Pomaga to muzykom generować nowe pomysły lub tworzyć ścieżki w tle do różnych celów.

Wykrywanie praw autorskich

Sztuczna inteligencja może identyfikować treści muzyczne chronione prawem autorskim, pomagając platformom egzekwować umowy licencyjne i zapewniać płatności artystom.

Klasyfikacja muzyki

Automatyczne tagowanie może pomóc w klasyfikowaniu utworów muzycznych na podstawie gatunku, nastroju, tempa, tonacji i innych atrybutów, ułatwiając słuchaczom wyszukiwanie i odkrywanie nowej muzyki.

Tworzenie listy odtwarzania

Analizując i kategoryzując muzykę za pomocą automatycznego tagowania, usługi przesyłania strumieniowego mogą automatycznie generować listy odtwarzania dostosowane do preferencji użytkowników lub określonych tematów, takie jak listy odtwarzania ćwiczeń lub listy odtwarzania do nauki.

Licencjonowanie muzyki

Biblioteki muzyczne i platformy licencyjne mogą korzystać z automatycznego tagowania w celu uporządkowania swojego katalogu i ułatwienia klientom znalezienia odpowiedniej ścieżki dla swoich projektów, takich jak reklamy, filmy lub gry wideo.

Jak pomaga Shaip

Shaip oferuje usługi gromadzenia i transkrypcji danych w celu tworzenia modeli uczenia maszynowego dla branży muzycznej. Nasz profesjonalny zespół zajmujący się gromadzeniem i transkrypcją muzyki specjalizuje się w gromadzeniu i transkrypcji muzyki, aby pomóc Ci w tworzeniu modeli uczenia maszynowego.

Nasze kompleksowe rozwiązania dostarczają wysokiej jakości, różnorodnych danych z różnych źródeł, torując drogę dla przełomowych zastosowań w rekomendacjach muzycznych, komponowaniu, transkrypcji i analizie emocji. Zapoznaj się z tą broszurą, aby dowiedzieć się, w jaki sposób nasz skrupulatny proces sprawdzania danych i najwyższej klasy usługi transkrypcji mogą przyspieszyć proces uczenia maszynowego, zapewniając przewagę nad konkurencją w dzisiejszym dynamicznym środowisku muzycznym. Przekształć swoje muzyczne ambicje w rzeczywistość dzięki naszej niezrównanej wiedzy i dążeniu do doskonałości.

Zbieranie danych

Odblokuj przyszłość branży muzycznej, wykorzystując moc sztucznej inteligencji (AI) dzięki naszym obszernym danym szkoleniowym AI dla branży muzycznej. Nasz skrupulatnie wyselekcjonowany zestaw danych umożliwia modelom uczenia maszynowego generowanie przydatnych spostrzeżeń, rewolucjonizując sposób rozumienia i interakcji z krajobrazem muzycznym. Możemy pomóc Ci zbierać dane muzyczne z następujących źródeł z dodatkowymi kryteriami, takimi jak:

| Gatunki muzyki | Ekspertyza mówcy | Obsługiwane języki | Różnorodność |

|---|---|---|---|

| Pop, rock, jazz, muzyka klasyczna, country, hip-hop/rap, folk, heavy metal, disco i nie tylko. | Początkujący, średniozaawansowany, profesjonalista | Angielski, hindi, tamilski, arabski itp. | Mężczyzna, kobieta, dzieci. |

Transkrypcja danych

Nazywany również adnotacją lub etykietowaniem danych, nasz proces polega na ręcznym wprowadzaniu partytury muzycznej do specjalistycznego oprogramowania, umożliwiając klientom dostęp do zapisanej muzyki i towarzyszącego jej pliku audio mp3, który symuluje partyturę podczas gry komputerowej. Możemy dokładnie uchwycić partię każdego instrumentu, szczycąc się utalentowanymi transkryptorami muzyki z doskonałym dźwiękiem. Nasze rozległe doświadczenie pozwala nam tworzyć różnorodne partytury muzyczne, od prostych transkrypcji arkuszy wiodących po skomplikowane kompozycje jazzowe, fortepianowe lub orkiestrowe z udziałem wielu instrumentów. Oto kilka przypadków użycia transkrypcji lub etykietowania muzyki.

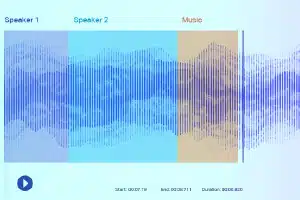

Etykietowanie dźwiękowe

Dzięki etykietom dźwiękowym osoby dokonujące adnotacji danych otrzymują nagranie i muszą oddzielić wszystkie potrzebne dźwięki i oznaczyć je etykietami. Mogą to być na przykład określone słowa kluczowe lub dźwięk określonego instrumentu muzycznego.

Klasyfikacja muzyczna

Adnotatorzy danych mogą oznaczać gatunki lub instrumenty w tego rodzaju adnotacjach dźwiękowych. Klasyfikacja muzyki jest bardzo przydatna do organizowania bibliotek muzycznych i ulepszania rekomendacji użytkowników.

Segmentacja poziomu fonetycznego

Oznaczenie i klasyfikacja segmentów fonetycznych na falach i spektrogramach nagrań osób śpiewających acapella.

Klasyfikacja dźwięku

Z wyjątkiem ciszy/białego szumu plik audio zazwyczaj składa się z następujących typów dźwięków: Mowa, Bełkot, Muzyka i Szum. Dokładnie dodawaj notatki muzyczne, aby uzyskać większą dokładność.

Przechwytywanie informacji o metadanych

Przechwyć ważne informacje, takie jak czas rozpoczęcia, czas zakończenia, identyfikator segmentu, poziom głośności, podstawowy typ dźwięku, kod języka, identyfikator mówcy i inne konwencje transkrypcji itp.