Obecnie z Internetu korzysta ponad 5.19 miliarda osób. To ogromna publiczność, prawda?

Sama ilość treści generowanych w Internecie jest po prostu oszałamiająca. Od aktualizacji w mediach społecznościowych i postów na blogach po komentarze użytkowników i przesyłane multimedia – świat online jest ogromnym i dynamicznym repozytorium informacji.

Jednak nie wszystkie treści są dobre. Niektóre mogą obrażać różne grupy ze względu na wiek, rasę, płeć, narodowość lub pochodzenie etniczne. Takie treści wymagają uważnej obserwacji. Zapewnia to każdemu spokój i harmonię.

Dlatego istnieje pilna potrzeba moderacji treści. Mimo że ręczny przegląd jest skuteczny, istnieją pewne ograniczenia, których nie możemy zignorować. I tu właśnie skuteczna staje się automatyczna moderacja treści. Ta skuteczna metoda zapewnia bezpieczne korzystanie z Internetu i chroni użytkowników przed potencjalnymi szkodami.

W tym artykule porozmawiamy o nieocenionych korzyściach i różnorodnych typach dostępnych w narzędziach do automatycznej moderacji (wstępnie przeszkolonych przy użyciu solidnych zbiorów danych).

Zrozumienie automatycznej moderacji treści

Zautomatyzowana moderacja treści wykorzystuje technologię do nadzorowania treści generowanych przez użytkowników i zarządzania nimi. Zamiast ludzi skanujących każdy post, całą robotę wykonują algorytmy i uczenie maszynowe. Szybko identyfikują szkodliwe lub nieodpowiednie treści. Systemy te uczą się na podstawie ogromnych zbiorów danych i podejmują decyzje w oparciu o ustalone kryteria, wstępnie przeszkolone z udziałem człowieka.

Zautomatyzowane metody moderacji treści mogą być bardzo skuteczne. Pracują przez całą dobę i błyskawicznie przeglądają duże ilości treści. Jednak uzupełniają także recenzentów-ludzi. Czasami ludzki dotyk jest niezbędny dla kontekstu. To połączenie zapewnia bezpieczniejszą przestrzeń online, ponieważ użytkownicy mogą korzystać z tego, co najlepsze z obu światów.

Chcesz platformy wolnej od szkodliwych treści? Rozwiązaniem będzie automatyczna moderacja treści. Wyjaśnimy to bardziej, gdy przeczytasz poniższe rodzaje i korzyści.

[Przeczytaj także: Niezbędny przewodnik po moderowaniu treści]

Rodzaje automatycznej moderacji

Zautomatyzowana moderacja treści znacznie ewoluowała na przestrzeni lat. Obecnie obejmuje szereg technologii i podejść, z których każde ma na celu zaspokojenie określonych potrzeb. Oto bliższe spojrzenie na różne typy:

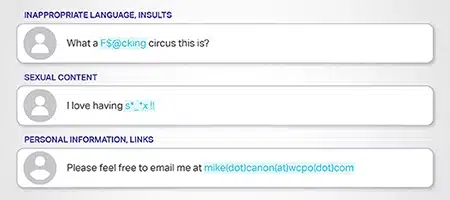

Moderacja oparta na słowach kluczowych

Ta metoda działa na predefiniowanych listach słów zakazanych lub oznaczonych flagą. Jeśli treść zawiera te słowa, system albo odmawia jej publikacji, albo przesyła ją do sprawdzenia. Platformy mogą na przykład blokować wulgarny język lub terminy powiązane z mową nienawiści.

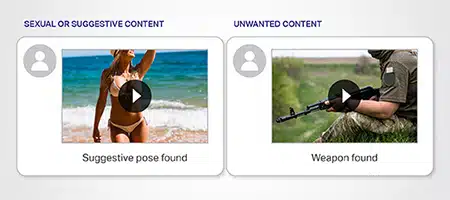

Moderacja rozpoznawania obrazu

Wykorzystując możliwości uczenia maszynowego, metoda ta identyfikuje nieodpowiednie lub oznaczone obrazy. Potrafi wykryć materiały wizualne promujące przemoc, treści wulgarne lub materiały chronione prawem autorskim. Zaawansowane algorytmy analizują wzorce wizualne, aby mieć pewność, że żaden szkodliwy obraz nie pozostanie niezauważony.

Moderacja analizy wideo

Podobnie jak w przypadku rozpoznawania obrazu, analiza wideo rozkłada komponenty wideo klatka po klatce. Sprawdza, czy nie występują nieodpowiednie elementy wizualne, sygnały dźwiękowe lub oznaczone treści. Jest to nieocenione na platformach takich jak YouTube, gdzie dominuje treść wideo.Umiarkowanie w analizie sentymentów

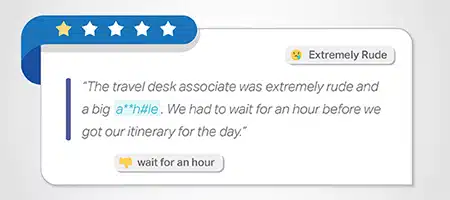

Zrozumienie uczuć i emocji kryjących się za treścią jest niezwykle istotne. Ta metoda ocenia ton treści i oznacza treści, które są nadmiernie negatywne, promują nienawiść lub podsycają szkodliwe uczucia. Jest to szczególnie przydatne na forach i platformach promujących pozytywne interakcje społeczne.

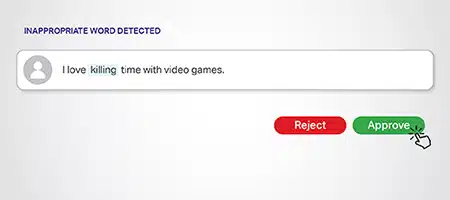

Moderacja kontekstowa

Treść często wymaga kontekstu dla dokładnej moderacji. Ta metoda ocenia treść w otaczającym ją kontekście. Zapewnia, że prawdziwa treść, nawet zawierająca oznaczone słowa, nie zostanie bezprawnie zablokowana, jeśli ogólny kontekst jest nieszkodliwy. W przykładzie – zawiera słowo „zabijanie”, w kontekście jest łagodne, nawiązując do nieszkodliwej czynności polegającej na graniu w gry

Moderacja oparta na reputacji użytkownika

Użytkownicy, którzy w przeszłości naruszali wytyczne, mogą wymagać dokładniejszej analizy. Ten system moderuje na podstawie reputacji użytkownika. W przypadku osób, które dopuściły się wcześniejszych naruszeń, ich treści mogą zostać sprawdzone bardziej rygorystycznie niż w przypadku osób, które nie mają żadnych wątpliwości.

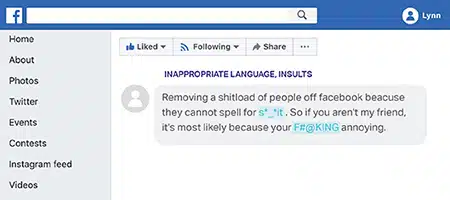

Moderacja monitorowania mediów społecznościowych

Biorąc pod uwagę ogromną ilość treści generowanych w mediach społecznościowych, specjalistyczne narzędzia monitorują te platformy. Wykrywają w czasie rzeczywistym potencjalne problemy, takie jak dezinformacja, fałszywe wiadomości lub trolling. Pomaga stworzyć czystsze i bezpieczniejsze środowisko mediów społecznościowych.

Korzyści z automatycznej moderacji

Automatyzacja niesie ze sobą różne korzyści. Przyjrzyjmy się bliżej korzyściom, jakie oferuje automatyczna moderacja treści:

Efektywne filtrowanie treści

Wraz z napływem treści generowanych przez użytkowników (UGC) platformy potrzebują systemów do przeglądania ogromnych ilości. Oferty automatycznej moderacji treści wydajne filtrowanie treści. Daje pewność, że światło dzienne ujrzą tylko odpowiednie materiały.

Zwiększone bezpieczeństwo cyfrowe

Bezpieczeństwo w Internecie jest ważne, aby zwiększyć zaufanie użytkowników do korzystania z Internetu. Automatyzacja pomaga zachować bezpieczeństwo cyfrowe, wykrywając szkodliwe treści. Od mowy nienawiści po nękanie w Internecie – powstrzymuje tego typu zagrożenia.

Przestrzeganie Wytycznych społeczności

Wytyczne społeczności zapewniają integralność platformy. Automatyzacja gwarantuje, że te zasady nie zostaną naruszone i pomaga tworzyć harmonijne przestrzenie online.

Zwalczanie nękania i mowy nienawiści w Internecie

Zautomatyzowane systemy mogą szybko identyfikować i eliminować nękanie i mowę nienawiści w Internecie. Zapewniają, że platformy pozostają przyjazne i bezpieczne, oznaczając szkodliwe treści.

Przeciwdziałanie dezinformacji i fałszywym wiadomościom

W wieku szalejąca dezinformacjaautomatyzacja odgrywa kluczową rolę. Wykrywa i tłumi dezinformację/fałszywe wiadomości, aby zachować prawdę i dokładność.

Walka z trollingiem

Trolling może zrujnować dialogi online i wykoleić znaczące rozmowy. Automatyczna moderacja treści wykrywa te trolle i pomaga w utrzymaniu pozytywnego środowiska. Wyobraź sobie klasę. IT działa jak ostrożna siła, która promuje konstruktywne interakcje i zapewnia użytkownikom lepsze doświadczenia.

Dogłębnej analizy

Analiza tekstu wykracza poza zwykłe wykrywanie słów kluczowych. Rozumie kontekst i promuje autentyczne treści, jednocześnie usuwając szkodliwe narracje. Oprócz tekstów narzędzia do rozpoznawania obrazów wykrywają nieodpowiednie elementy wizualne. Zapewniają zgodność obrazów ze standardami platformy.

Kompleksowa moderacja wideo

Treści wideo dominują w przestrzeni cyfrowej, ponieważ ludzie uwielbiają angażujące efekty wizualne. Wkracza automatyzacja, aby zagwarantować, że te filmy spełniają określone standardy. Przesiewa ogromne ilości treści, wykrywa szkodliwe elementy i natychmiast je usuwa.

Wnioski

Zautomatyzowana moderacja treści wiąże się zarówno z korzyściami, jak i wyzwaniami. Doskonale radzi sobie z usuwaniem nieodpowiednich treści z platform cyfrowych. Jednak napotyka również ograniczenia i wywołuje debaty na temat cenzury i roli technologii. W wielu przypadkach w przypadku niejasności wymagana jest także specjalistyczna moderacja ze strony ludzi.

Platformy powinny jasno określać zasady moderacji. Potrzebują także systemów umożliwiających użytkownikom kwestionowanie decyzji o usunięciu treści pod kątem uczciwości i dokładności. Przy odpowiedniej równowadze możemy osiągnąć sprawiedliwość dla użytkowników Internetu, zachowując jednocześnie ich bezpieczeństwo i przestrzegając ich praw.

Ta metoda działa na predefiniowanych listach słów zakazanych lub oznaczonych flagą. Jeśli treść zawiera te słowa, system albo odmawia jej publikacji, albo przesyła ją do sprawdzenia. Platformy mogą na przykład blokować wulgarny język lub terminy powiązane z mową nienawiści.

Ta metoda działa na predefiniowanych listach słów zakazanych lub oznaczonych flagą. Jeśli treść zawiera te słowa, system albo odmawia jej publikacji, albo przesyła ją do sprawdzenia. Platformy mogą na przykład blokować wulgarny język lub terminy powiązane z mową nienawiści. Wykorzystując możliwości uczenia maszynowego, metoda ta identyfikuje nieodpowiednie lub oznaczone obrazy. Potrafi wykryć materiały wizualne promujące przemoc, treści wulgarne lub materiały chronione prawem autorskim. Zaawansowane algorytmy analizują wzorce wizualne, aby mieć pewność, że żaden szkodliwy obraz nie pozostanie niezauważony.

Wykorzystując możliwości uczenia maszynowego, metoda ta identyfikuje nieodpowiednie lub oznaczone obrazy. Potrafi wykryć materiały wizualne promujące przemoc, treści wulgarne lub materiały chronione prawem autorskim. Zaawansowane algorytmy analizują wzorce wizualne, aby mieć pewność, że żaden szkodliwy obraz nie pozostanie niezauważony.

Zrozumienie uczuć i emocji kryjących się za treścią jest niezwykle istotne. Ta metoda ocenia ton treści i oznacza treści, które są nadmiernie negatywne, promują nienawiść lub podsycają szkodliwe uczucia. Jest to szczególnie przydatne na forach i platformach promujących pozytywne interakcje społeczne.

Zrozumienie uczuć i emocji kryjących się za treścią jest niezwykle istotne. Ta metoda ocenia ton treści i oznacza treści, które są nadmiernie negatywne, promują nienawiść lub podsycają szkodliwe uczucia. Jest to szczególnie przydatne na forach i platformach promujących pozytywne interakcje społeczne. Treść często wymaga kontekstu dla dokładnej moderacji. Ta metoda ocenia treść w otaczającym ją kontekście. Zapewnia, że prawdziwa treść, nawet zawierająca oznaczone słowa, nie zostanie bezprawnie zablokowana, jeśli ogólny kontekst jest nieszkodliwy. W przykładzie – zawiera słowo „zabijanie”, w kontekście jest łagodne, nawiązując do nieszkodliwej czynności polegającej na graniu w gry

Treść często wymaga kontekstu dla dokładnej moderacji. Ta metoda ocenia treść w otaczającym ją kontekście. Zapewnia, że prawdziwa treść, nawet zawierająca oznaczone słowa, nie zostanie bezprawnie zablokowana, jeśli ogólny kontekst jest nieszkodliwy. W przykładzie – zawiera słowo „zabijanie”, w kontekście jest łagodne, nawiązując do nieszkodliwej czynności polegającej na graniu w gry Użytkownicy, którzy w przeszłości naruszali wytyczne, mogą wymagać dokładniejszej analizy. Ten system moderuje na podstawie reputacji użytkownika. W przypadku osób, które dopuściły się wcześniejszych naruszeń, ich treści mogą zostać sprawdzone bardziej rygorystycznie niż w przypadku osób, które nie mają żadnych wątpliwości.

Użytkownicy, którzy w przeszłości naruszali wytyczne, mogą wymagać dokładniejszej analizy. Ten system moderuje na podstawie reputacji użytkownika. W przypadku osób, które dopuściły się wcześniejszych naruszeń, ich treści mogą zostać sprawdzone bardziej rygorystycznie niż w przypadku osób, które nie mają żadnych wątpliwości. Biorąc pod uwagę ogromną ilość treści generowanych w mediach społecznościowych, specjalistyczne narzędzia monitorują te platformy. Wykrywają w czasie rzeczywistym potencjalne problemy, takie jak dezinformacja, fałszywe wiadomości lub trolling. Pomaga stworzyć czystsze i bezpieczniejsze środowisko mediów społecznościowych.

Biorąc pod uwagę ogromną ilość treści generowanych w mediach społecznościowych, specjalistyczne narzędzia monitorują te platformy. Wykrywają w czasie rzeczywistym potencjalne problemy, takie jak dezinformacja, fałszywe wiadomości lub trolling. Pomaga stworzyć czystsze i bezpieczniejsze środowisko mediów społecznościowych.